Entre mythes, « hypes » et tensions dans les imaginaires journalistiques et collectifs

Depuis le lancement de ChatGPT le 30 novembre 2022, l’intelligence artificielle générative a déclenché un engouement mondial sans précédent. Pour la première fois, une technologie capable de produire un langage fluide et cohérent devient accessible au grand public. Cette accessibilité, combinée à une forte tendance à l’anthropomorphisme, nourrit l’idée que ces systèmes possèdent des capacités cognitives comparables à celles de l’humain. L’IA devient alors autant un phénomène culturel qu’une innovation technique.

Parce que dans l’esprit de nombreux utilisateurs, l’IA générative, c’est de l’IA tout court, l’un des premiers enjeux consiste à dissiper la confusion entre intelligence artificielle et intelligence artificielle générative. L’IA, qui est un champ de recherche dont les origines remontent à l’après Seconde Guerre mondiale, englobe des technologies prédictives, analytiques ou encore robotiques bien au-delà de la génération de texte ou d’images. Assimiler l’IA à la seule génération masque cette diversité et entretient l’illusion que nous serions proches d’une intelligence artificielle générale, alors que nous restons dans le domaine d’IA spécialisées et probabilistes.

Les systèmes d’IA générative s’inscrivent dans un ensemble d’imaginaires technologiques qui façonnent la manière dont nous les percevons. L’anthropomorphisme amène à attribuer à la machine une subjectivité qu’elle n’a pas, comme si la fluidité du langage révélait une intériorité ou une intention. S’ajoute l’imaginaire du double ou de l’automate : la machine apparaît comme un miroir de l’humain qui écrit et parle, elle devient un autre soi, tantôt fascinant, tantôt inquiétant. Ces projections s’articulent à une représentation plus large du progrès technologique, où l’IA incarne tour à tour l’innovation, l’efficacité, la modernité, tout en demeurant une promesse ambivalente : outil d’émancipation ou menace pour l’humain.

Si les modèles actuels impressionnent par leur fluidité linguistique, ils fonctionnent sur des mécanismes statistiques et prédictifs. Ils ne comprennent pas le sens mais calculent des probabilités de mots dans des espaces mathématiques abstraits. Cette architecture explique les hallucinations, les erreurs factuelles et la reproduction de biais issus des données d’entraînement. L’écart entre la performance apparente et la réalité technique alimente un malentendu profond sur leurs capacités réelles.

Au‑delà des limites inhérentes à leurs données d’entraînement, les grands modèles de langage deviennent également des vecteurs de désinformation lorsqu’ils sont délibérément manipulés par des acteurs malveillants. Des enquêtes récentes montrent que des réseaux organisés mènent des opérations de « grooming » et de « data poisoning », inondant le web de contenus pro‑Kremlin optimisés pour être absorbés par les modèles et réapparaître dans leurs réponses. En parallèle, des attaques plus techniques cherchent à insérer des instructions cachées ou des échantillons corrompus dans les données d’entraînement afin de créer des biais persistants ou des déclencheurs invisibles. Selon la société Anthropic, qui commercialise le modèle Claude, 250 documents corrompus seraient suffisants pour infecter un modèle, quelle que soit sa taille.

Entre fictions et réalités, le médium brouille le message. Son interface fluide et facile à prendre en mains renforce l’illusion d’une intentionnalité et d’une compréhension qui n’existent pas. Cette expérience technologique impacte la manière dont nous percevons le contenu généré, au point que les utilisateurs en viennent à projeter sur ces systèmes des compétences, des intentions ou une cohérence qu’ils ne possèdent pas. De plus, cette projection n’est jamais neutre : elle s’appuie sur nos représentations culturelles de l’intelligence, du langage ou de la rationalité, et conditionne nos rapports à ces technologies.

La philosophe Hannah Arendt avait souligné que le totalitarisme détruit la frontière entre réalité et fiction en imposant une pseudo‑réalité cohérente mais fabriquée, qui finit par dissoudre le monde commun. Sans parler de « totalitarisme technologique », son analyse éclaire un risque contemporain : des systèmes génératifs capables de produire des récits plausibles contribuent, par leur seule architecture, à rendre le vrai, le faux et le vraisemblable difficiles à distinguer.

Acteurs dominants et bulle de l’IA

Le récit de l’IA est porté par les grandes entreprises technologiques américaines – Apple, Microsoft, Alphabet, Amazon, Meta, NVIDIA et Tesla. Elles concentrent la puissance de calcul, les infrastructures cloud et les données. L’IA constitue pour elles un enjeu stratégique majeur, ce qui implique des investissements massifs et une forte attente de retour sur investissement. Leurs représentants parlent régulièrement de super-intelligence ou d’« IA générale » capable de dépasser l’humain dans de nombreuses tâches intellectuelles comme le raisonnement, la programmation, ou la création de contenu.

Ces affirmations exagèrent les capacités réelles des technologies actuelles : il s’agit d’IA étroites, conçues pour exécuter des tâches spécifiques dans des environnements définis, sans compréhension du contexte, sans autonomie véritable et sans aptitude à généraliser au‑delà des données et des fonctions pour lesquelles elles ont été entraînées.

Rien ne permet aujourd’hui d’établir scientifiquement que les grands modèles de langage constituent une voie vers une intelligence générale : ils restent des systèmes étroits, spécialisés, et leurs limites sont largement documentées. L’un des chercheurs majeurs de l’IA moderne, Yann LeCun s’est d’ailleurs publiquement détourné de cette approche. Longtemps à la tête du laboratoire IA chez Meta, il critique de plus en plus ouvertement l’obsession industrielle pour ces modèles, qu’il juge incapables de mener à une intelligence humaine ou à une compréhension du monde.

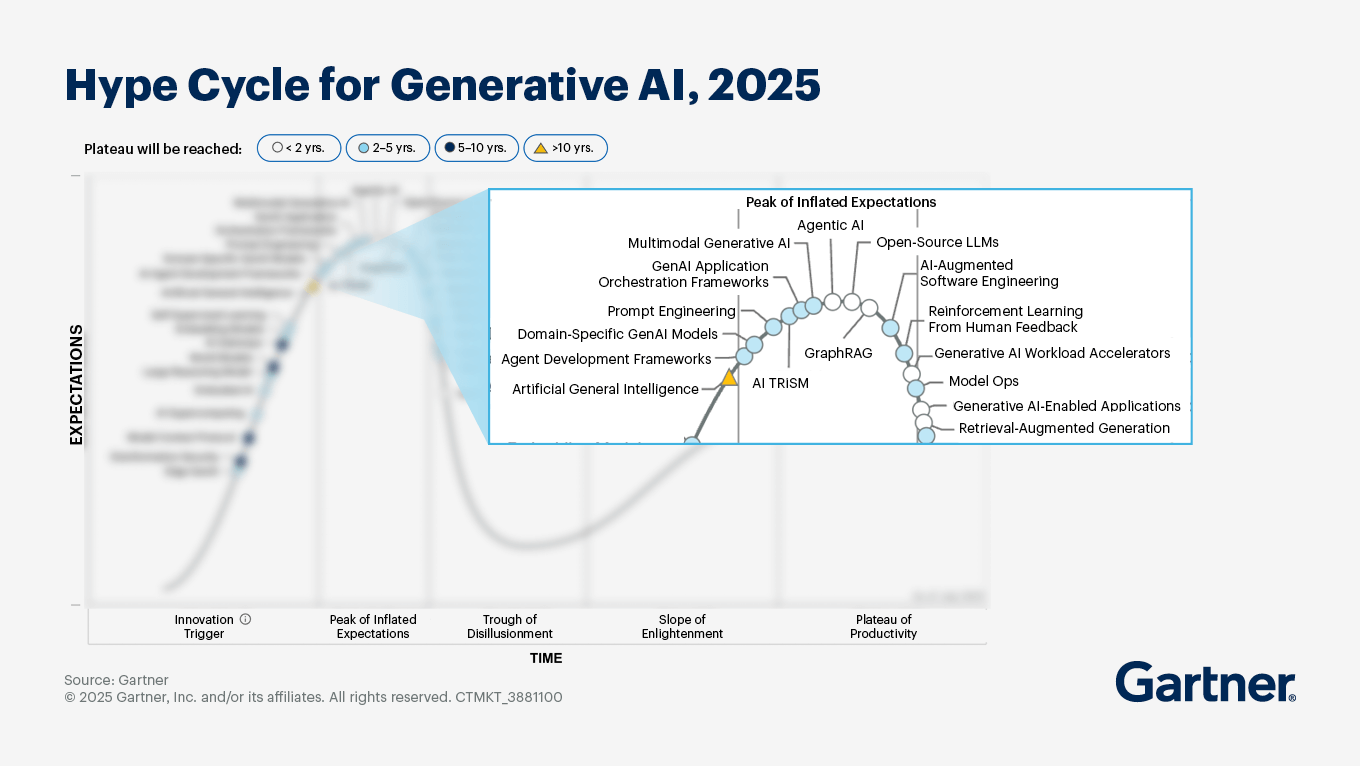

Les promesses des acteurs de l’IA sont celles de stratégies marketing visant à séduire un maximum d’entreprises et de consommateurs, alimentée par un effet de mode et un engouement sans précédent pour les technologies de l’IA. Mais si l’on approche ce phénomène sous l’angle du cycle du hype de l’IA élaboré par la société de consultance américaine Gartner, on constate que chaque nouvelle vague technologique connaît un pic d’attentes démesurées avant de retomber dans une phase de désillusion.

Il n’en va pas différemment avec les grands modèles de langage, une « révolution » qui se heurte frontalement à la question du retour sur investissement : les promesses industrielles se brisent sur des coûts énergétiques élevés, des infrastructures lourdes et une mobilisation importante de ressources humaines. Ceci explique sans doute partiellement une stratégie marketing fondée sur la peur, exploitant les angoisses des entreprises et des individus afin de promouvoir une adoption rapide des technologies d’IA.

Les messages se déclinent toujours selon les mêmes ressorts : la peur d’être dépassé si l’on n’intègre pas l’IA ; la peur de perdre son emploi ou de devenir inutile s’il l’on ne se forme pas ; la peur de l’obsolescence créative ou technique, où les compétences humaines seraient soudain sans valeur ; et enfin la peur de manquer de vision, comme si ne pas adopter immédiatement ces outils revenait à renoncer à l’innovation.

Reste que la peur se trouve aussi sans doute du côté du big tech américain, alors que des milliards d’euros d’investissements ne donnent pas encore lieu aux plantureux bénéfices escomptés. Open AI était déficitaire en 2025 et le sera encore au moins jusqu’en 2030. Pour de nombreux observateurs, c’est l’un des nombreux symptômes de la bulle IA, comparée à la bulle internet du début des années 2000.

Valorisations extrêmes, dette élevée, concentration du marché, promesses non rencontrées et faibles retours sur investissements sont autant d’arguments susceptibles de justifier un désengagement des investisseurs. Une bulle technologique se termine généralement par une correction de marché, souvent un krach, lorsque la réalité ne correspond pas aux attentes démesurées, souligne le philosophe Luciano Floridi.

De plus, le développement de l’IA s’inscrit dans un contexte de rivalités internationales, où chaque puissance cherche à sécuriser sa position technologique, tout en faisant face à une régulation croissante. En Europe, l’AI Act impose un cadre fondé sur le risque, définissant des obligations proportionnées selon les usages et les niveaux de dangerosité. Mais cette approche entre parfois en tension avec les objectifs commerciaux des entreprises, pour qui ces contraintes peuvent freiner la mise sur le marché ou limiter l’exploitation de données à grande échelle.

C’est pourquoi les IA génératives ne peuvent être considérées comme neutres. En premier lieu, leurs objectifs commerciaux façonnent leur fonctionnement. Il s’agit donc de maximiser l’engagement, la productivité ou la rentabilité plutôt que la vérité, la diversité ou la nuance. De plus, ces modèles reflètent les propriétés de leur conception. Leurs corpus d’entraînement proviennent du web et comportent des biais culturels, idéologiques ou historiques. Leur architecture technique, quant à elle, encode les choix de leurs concepteurs qui orientent inévitablement les réponses.

La représentation de l’IA dans les médias

Les médias d’information contribuent souvent, malgré eux, à amplifier les récits portés par les grandes entreprises technologiques. En reprenant sans recul le récit de l’inévitabilité, ils présentent l’IA générative comme une révolution incontournable, marginalisant les voix critiques. Cette dynamique s’accompagne d’un IA‑washing : des affirmations reprises sans vérification, un vocabulaire marketing (« intelligent », « révolutionnaire ») adopté tel quel. S’ajoutent une tendance à personnaliser les systèmes d’IA, les présentant comme pouvant penser, aimer, rêver, ce qui est loin d’être le cas.

Dans ce cadre, les risques sont fréquemment minimisés : impact environnemental massif, atteintes au droit d’auteur, dépendance à quelques fournisseurs dominants, autant d’éléments souvent relégués au second plan. Cette couverture médiatique contribue ainsi à installer une vision déséquilibrée de l’IA, où les promesses prennent le pas sur les enjeux réels. Mais elle est aussi renforcée par certains acteurs des médias eux-mêmes, dans une approche proactive et enthousiaste (on parle souvent d’« évangélisation ») où l’IA générative est mise en avant en tant que levier de transformation positif.

A contrario, les initiatives critiques ne sont pas ou peu relayées, ne bénéficiant dès lors pas du même niveau de visibilité. Une lettre ouverte publiée en juin 2025 par des universitaires néerlandais appelle explicitement à stopper l’adoption non critique des technologies d’IA générative dans les universités, dénonçant leur impact sur l’intégrité scientifique, la formation intellectuelle et l’autonomie des étudiants.

De même, en novembre 2025, plus de 280 scientifiques européens ont adressé une lettre ouverte à Ursula von der Leyen, la présidente de la Commission européenne, l’exhortant à revoir ses propos amplifiant le discours du hype, après qu’elle ait affirmé que l’IA pourrait atteindre un « raisonnement humain » en se fondant sur des arguments marketing de dirigeants de la tech plutôt que sur des preuves scientifiques. Ces exemples rappellent que des voix expertes s’opposent à la rhétorique triomphante et appellent à une approche plus scientifique et raisonnée de l’IA.

Ceci soulève une question centrale : celle de l’expertise. Pour couvrir un domaine aussi complexe que l’intelligence artificielle, les journalistes ont besoin de spécialistes capables d’éclairer à la fois les dimensions techniques et les enjeux sociétaux. L’essor rapide de l’IA générative a vu apparaître une multitude d’experts autoproclamés, parfois formés à la hâte après quelques expérimentations avec ChatGPT.

Quand un « expert » affirme que « les réseaux neuronaux artificiels dépassent déjà largement les capacités humaines », il omet souvent de préciser qu’il s’agit de performances très spécifiques sur certaines tâches, et non d’une supériorité générale comparable à l’intelligence humaine. Cette affirmation crée donc une confusion entre performance spécialisée et intelligence générale. Lorsque le même « expert » prend pour exemple le réseau Moltbook, il faut rappeler qu’il existe des doutes quant au fait qu’il s’agisse réellement d’un système composé uniquement d’agents autonomes, ce qui rend l’argument discutable. Enfin, lorsqu’il affirme que le problème est que l’IA n’a pas de finalité intrinsèque, il présente comme une faiblesse ce qui est en réalité une caractéristique normale des systèmes artificiels, dont les objectifs sont définis par leurs concepteurs. C’est aussi un anthropomorphisme : un marteau n’a pas non plus la finalité de planter un clou de lui-même, c’est un outil.

Un autre exemple est celui de la simplification à outrance de notions comme le prompt engineering, comme si l’apprentissage de ces techniques avancées constituait un prérequis pour interagir de manière optimale avec les chatbots. Pour les interactions homme-machine destinées au grand public, la recherche récente privilégie plutôt des approches issues de la linguistique et de la pragmatique : des prompts formulés avec une clarté contextuelle, une structure simple et des intentions explicites sont souvent plus efficaces que des approches d’ingénierie complexes, généralement inadaptées aux utilisateurs non experts.

Ce type d’intervenants, très présents sur les réseaux sociaux et dans les médias, produit souvent une mésinformation involontaire. Mais les médias, en quête d’intervenants disponibles qui soient aussi de bons communicants ou vulgarisateurs, privilégient souvent ces « bons clients ». Cette dynamique illustre plus largement la reconfiguration des régimes d’expertise à l’ère des réseaux sociaux et des contenus générés par les utilisateurs, tout en soulignant la difficulté persistante pour les médias d’établir et de maintenir des critères robustes d’évaluation de l’expertise.

Parallèlement, l’IA générative est déjà largement utilisée au sein des rédactions, alors même que peu de médias rendent publiques des informations claires sur leurs pratiques. Tous ne publient ni charte encadrant l’usage de ces outils, ni page dédiée à ce sujet, et seules quelques dizaines de ces documents sont accessibles au public à l’échelle européenne. Cette opacité nuit à la confiance des audiences, d’autant que plusieurs cas récents ont montré qu’il est possible de tromper le public en faisant passer pour authentiques des articles prétendument rédigés par des journalistes.

Si les discours journalistiques manquent souvent de recul critique dès lors qu’il s’agit d’aborder les technologies d’intelligence artificielle, contribuant à alimenter le hype technologique, le ton est différent lorsque l’information est directement liée au champ journalistique. Le ton devient alors plus critique, évoquant la menace sur l’emploi journalistique, l’identité professionnelle et la prolifération de fake news. Les IA génératives apparaissent alors comme des amplificateurs de désinformation et comme des outils susceptibles de brouiller les frontières entre réalité et fiction.

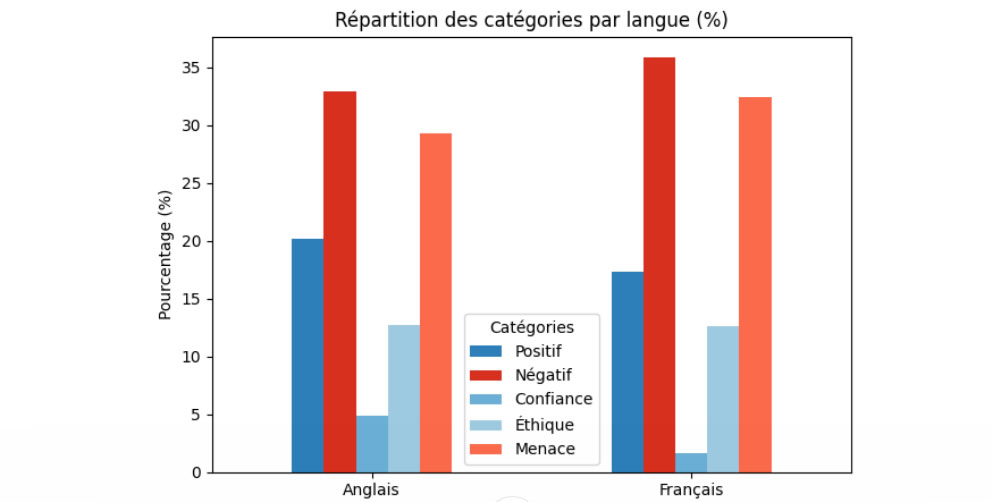

A l’Université de Bergen, nous avons analysé 841 titres de presse publiés entre 2018 et 2024, en français et en anglais. Les résultats révèlent une augmentation continue de la couverture médiatique de l’intelligence artificielle dans le journalisme, avec une forte accélération en 2023–2024. Cette période coïncide avec l’arrivée et la popularisation des modèles d’IA générative.

Les grands modèles de langage sont décrits à la fois comme des amplificateurs de désinformation (ex. fausses interviews, tribunes canulars, images réalistes produites par IA) et comme des outils de vérification potentiels. Cette ambivalence se retrouve dans les deux corpus linguistiques, mais la presse anglophone met davantage l’accent sur les potentialités industrielles, tandis que la presse francophone accorde davantage de place à la dimension éthique, réglementaire ou liée à la confiance du public.

Ceci démontre une prise de conscience collective des risques et dérives de l’utilisation d’IA génératives, tout en soulignant que les enjeux liés à l’IA générative ne peuvent être dissociés des désordres informationnels qu’elle contribue à amplifier.

Conclusion

L’IA racontée par la tech impose un récit qui oriente les imaginaires collectifs : un récit où l’innovation est présentée comme inéluctable, où la compétition mondiale sert de justification permanente, et où la promesse d’une intelligence quasi humaine masque les limites, les coûts et les risques bien réels des systèmes actuels. Cette narration hégémonique contribue à structurer ce que l’on pense possible, souhaitable ou nécessaire, et façonne autant les attentes du public que les stratégies des organisations.

Face à ce discours performatif, il est essentiel de développer une culture critique de l’IA, fondée sur la compréhension des mécanismes techniques, des enjeux économiques et des effets sociopolitiques de ces technologies. L’éducation à l’IA, qu’elle soit scolaire, universitaire, professionnelle ou médiatique, n’est plus un supplément facultatif mais une condition de possibilité pour restaurer notre capacité à distinguer le vraisemblable du vrai, l’outil du mythe, et pour réinscrire les choix technologiques dans un espace de délibération démocratique plutôt que dans celui de l’enchantement ou de la peur.

Il ne s’agit pas seulement d’être équipé pour évaluer la qualité des contenus générés, mais aussi pour évaluer l’impact de ces technologies sur la société, dans un contexte où la désinformation circule plus rapidement et à plus grande échelle que les contenus vérifiés.