Quelle est la place réelle des technologies de l’IA dans les pratiques journalistiques et son potentiel face aux attentes parfois démesurées qui l’entourent ?

Jusqu’à la fin novembre 2022, date de lancement de ChatGPT, les technologies de l’intelligence artificielle (IA) étaient employées dans les médias d’information principalement pour quatre grands types d’applications :

- La génération automatique de textes à partir de données structurées : ce modèle data-to-text nécessite des données de haute qualité et s’applique principalement à des domaines limités en raison de cette exigence de qualité, comme le sport, les élections, les finances ou l’environnement.

- La recommandation et la personnalisation d’informations : ces systèmes utilisent les données des lecteurs en ligne pour améliorer leur expérience en leur proposant des contenus adaptés à leurs intérêts et comportements.

- L’analyse de grands ensembles de données à l’aide de l’apprentissage automatique : cela inclut des applications telles que la classification et la catégorisation de contenus, la prédiction de tendances, ou encore l’analyse de données textuelles via des techniques de traitement automatique du langage (NLP).

- Un soutien pour des tâches journalistiques répétitives et chronophages : l’IA est utilisée pour surveiller en temps réel les événements sur le web et les réseaux sociaux, permettant ainsi de détecter rapidement des informations importantes et de mener des activités de vérification.

Ces différents types d’activités participent à une approche par données dans le journalisme, qui n’est pas un phénomène neuf, mais qui connaît un essor particulier pour deux raisons principales : la datafication des pratiques, dans le sillage du journalisme de données et du journalisme “algorithmique”, et l’augmentation de la puissance de calcul des ordinateurs. Cela signifie que pour les professionnels engagés dans ces différentes pratiques, cela suppose de disposer de ressources humaines, de compétences spécialisées et de moyens financiers plus ou moins importants. C’est pourquoi les pratiques basées sur les technologies de l’IA se cantonnaient souvent à des contextes bien définis et visaient à répondre à des besoins précis : étendre une zone de couverture médiatique, répondre à des exigences d’immédiateté, explorer des stratégies de fidélisation et d’engagement des audiences, assister les journalistes dans des tâches particulièrement chronophages.

Le débat éthique concernait essentiellement les volets de la génération automatique de textes et de la distribution calibrée d’informations, considérant un nécessaire devoir d’information des audiences à propos des technologies et systèmes utilisés. En Europe, seuls deux conseils de presse avaient publié des recommandations à ce propos, ceux de Finlande et de Catalogne. Dans le monde académique, les réflexions éthiques étaient présentes mais concernaient un nombre limité de recherche. Tandis que, dans les milieux professionnels, le spectre du robot journaliste faisait craindre un grand remplacement. Il aura fallu attendre l’avènement des IA génératives pour relancer ces débats, sans pour autant que ceux-ci considèrent nécessairement le coeur même de ce qui font les technologies de l’IA : les données.

De l’IA sans en être forcément conscient

Les journalistes ont progressivement intégré les technologies de l’IA dans leurs pratiques quotidiennes, sans grande considération du type de technologies sous-jacentes à ces applications, tels que la correction orthographique, la recherche en ligne, le monitoring des réseaux sociaux, ou encore la transcription et la traduction automatiques. Ces pratiques, désormais généralisées, se sont intégrées de manière quasi naturelle dans les routines journalistiques, sans soulever de questionnements majeurs, qu’ils soient éthiques ou pratiques.

Le 30 novembre 2022 marque-t-il la fin de l’ère pré-IA génératives dans les médias d’information ? Oui et non. Le véritable point de rupture résiderait davantage dans le fait de donner accès à des fonctionnalités qui étaient jusque-là réservées aux professionnels de l’informatique et des données. Pour manipuler une IA générative, il n’est plus nécessaire de posséder des compétences spécifiques : une simple instruction, un prompt sur un écran, suffisent désormais pour interagir avec ces technologies. C’est pourquoi, dans les milieux journalistiques, l’IA a suscité un véritable engouement : l’IA accessible à tous, capable d’accomplir des tâches de manière rapide et impressionnante. La technologie est tellement impressionnante qu’elle a ravivé la peur du grand remplacement et une fois de plus soulevé la question de la valeur ajoutée du journaliste humain. Au fil des mois et des découvertes des nombreuses failles de ces systèmes, cet engouement est de plus en plus à nuancer.

En premier lieu, il apparaît que les grands modèles de langage comme ChatGPT, loin d’être infaillibles dans tous les cas, sont davantage utilisés pour des tâches secondaires qui ne mettent pas directement en jeu la qualité de l’information, en ce sens qu’elles nécessitent un contrôle humain. En second lieu, le recours à ce type de technologies pour les tâches les plus créatives du journalisme – générer des idées d’articles et d’angles – pose la question d’une possible déqualification. Ne dit-on pas qu’un esprit bien aiguisé nécessite d’être bien entraîné ? Reste que les discours dominants sont aussi enthousiastes qu’ils sont utopistes : les IA génératives seraient la révolution que le journalisme attendait pour reconfigurer pratiques professionnelles et modèles économiques. Pourtant, il convient de rester réaliste : que permettent ces IA que les technologies existantes ne permettaient pas ? Quels besoins spécifiques vont-elles réellement satisfaire ? Que reconfigurent-elles exactement ? Ne se trouve-t-on pas plutôt dans un effet de mode généralisé qui nous ferait voir les choses en bien plus grand qu’elles ne le sont réellement ?

Au-delà des discours, la réalité du terrain

Le programme « Journalisme AI » permet de se faire une meilleure idée de la réelle pénétration des technologies de l’IA dans les médias d’information. Ce programme, piloté par la London School of Economics (LSE), vise à promouvoir le développement de technologies responsables au sein des rédactions. Sur son site web, il publie une base de données qui répertorie 156 projets journalistiques s’appuyant sur l’IA, développés sur une période de 7 ans. La majorité de ces projets concernent la production et la distribution d’informations, avec près de 10% qui concernent spécifiquement les IA génératives et les médias synthétiques.

Ces données démontrent que l’utilisation de l’IA participe à une série de stratégies aux contours bien définis, mais que le volume n’est pas non plus celui auquel on pourrait s’attendre à l’échelle mondiale. Cela veut aussi dire, dans cette perspective, que l’usage des technologies de l’IA entend rencontrer des besoins spécifiques pour la récolte d’information, la vérification et l’enquête, mais aussi pour la segmentation des audiences. 40% de ces projets sont relatifs à des médias ou projets journalistiques européens. La majorité d’entre eux sont issus du Royaume-Uni et, dans une moindre mesure, d’Allemagne. Aucun de ces projets ne concerne la Belgique et ses autres pays voisins.

Une recherche sur l’intégration des technologies de l’IA et des IA génératives dans les pratiques de vérification de faits dans les pays nordiques – des pays réputés pour leur ouverture aux technologies émergentes – a démontré que les professionnels ne perçoivent pas l’IA comme une fin en soi mais plutôt comme un moyen, un outil qui ne peut se substituer aux compétences cognitives humaines complexes telles que l’analyse contextuelle ou la prise de décision critique. Certains fact-checkers ont fait état de leur scepticisme, d’un manque de confiance et d’une incapacité momentanée à trouver l’espace adéquat pour utiliser de l’IA générative.

Dans l’ensemble, la confiance dans les résultats fournis par les outils génératifs est limitée. Ces technologies sont également perçues comme posant plusieurs défis difficiles à relever dans le cadre de la vérification des faits, principalement en raison des problèmes de fiabilité associés aux systèmes d’IAG, que ce soit en termes de données d’entraînement ou d’hallucinations artificielles, ce qui peut entraîner une confusion ou une réduction de la confiance — « Nous allons nous créer beaucoup de travail supplémentaire simplement en parcourant les hallucinations possibles, en vérifiant toutes les sources, etc. » (FC_06_2).

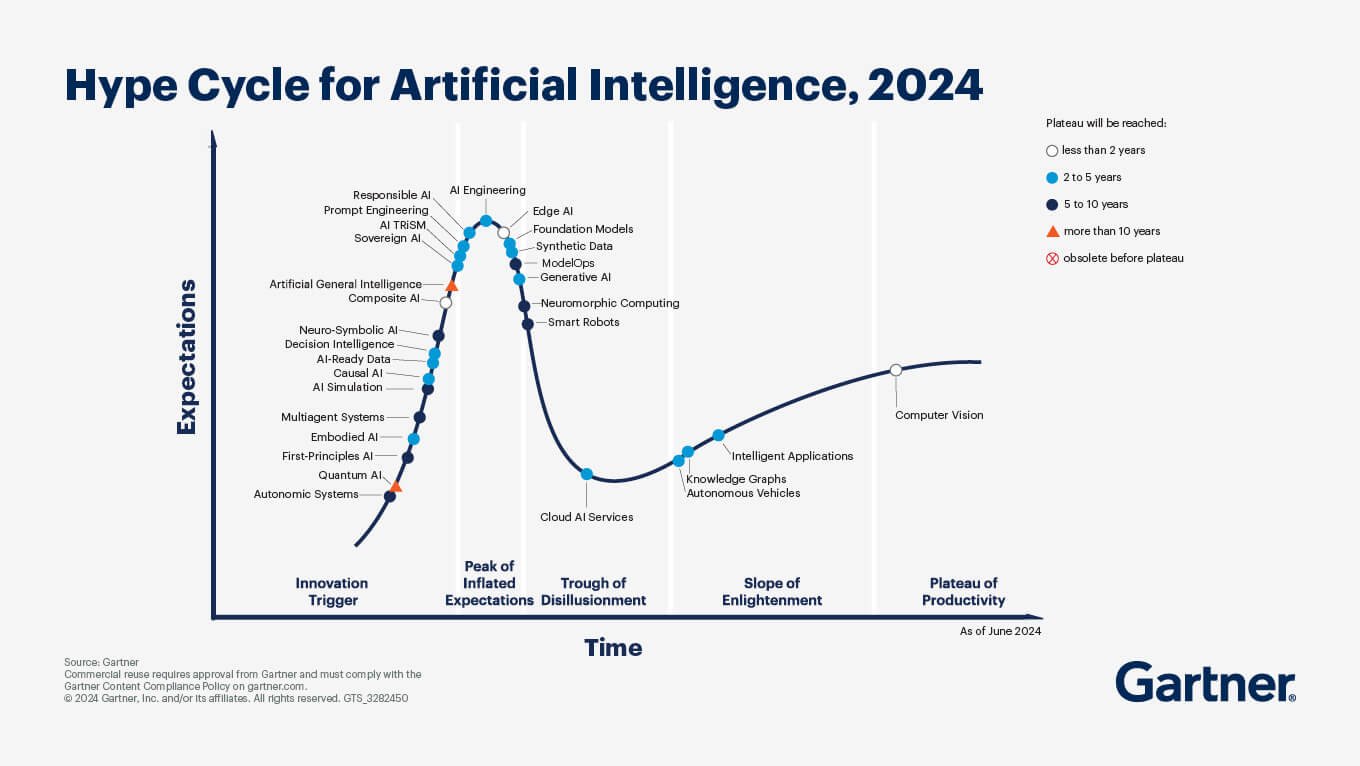

Le cycle du hype technologique

En marge des réalités de terrain, il est pertinent de s’interroger sur le phénomène du hype technologique, que l’on peut définir comme l’exagération médiatique et commerciale des capacités d’une technologie, souvent alimentée par des discours enthousiastes qui propagent une vision idéalisée de ses effets. Le cycle du hype a été défini par la société de consultance américaine Gartner. Il s’agit d’un modèle qui illustre l’évolution de la maturité, de l’adoption et de l’application sociale des technologies émergentes. Selon ce modèle, chaque technologie suit un parcours en cinq phases distinctes :

- L’activation du déclencheur technologique : Cette première phase est marquée par une percée technologique ou une innovation qui capte l’attention des médias et des investisseurs, générant un grand enthousiasme et une forte spéculation autour de son potentiel.

- Le sommet des attentes exagérées : À ce stade, l’enthousiasme est à son apogée, mais souvent, les attentes sont irréalistes. Les promesses de la technologie sont amplifiées, ce qui peut entraîner un hype excessif, où les véritables capacités de la technologie ne correspondent pas encore à l’imaginaire collectif.

- La vallée de la désillusion : Une fois que les premières expériences ne répondent pas aux attentes, la technologie entre dans une phase de déception. Les limitations deviennent apparentes, et l’adoption commence à ralentir. Certains abandonnent la technologie, tandis que d’autres cherchent des moyens de la faire progresser.

- La pente de l’illumination : Après avoir surmonté les obstacles initiaux, la technologie commence à mûrir. Des solutions pratiques et des cas d’utilisation concrets émergent, et l’adoption se stabilise. Les promesses initiales sont ajustées à la réalité, et l’intérêt renait autour de la technologie.

- Le plateau de productivité : La technologie devient pleinement intégrée dans des applications pratiques, avec une adoption croissante et une utilisation réelle et utile dans divers secteurs. Elle atteint un niveau de maturité où ses avantages sont bien compris et où elle commence à offrir un retour sur investissement tangible.

Entre stratégies marketing et discours journalistiques

Le cycle du hype illustre bien comment les technologies émergentes traversent des phases de surestimation et de déception avant de trouver leur véritable place dans les pratiques. En observant cette dynamique, nous nous trouverions entre les sommets de la pente exagérée et la vallée de la désillusion. Il est d’ailleurs fort possible que la pente de l’illumination tarde à pointer le bout du nez. OpenAI vient d’annoncer que la version 5 de son GPT n’est pas prête, car pas aussi performante qu’attendu malgré des dépenses conséquentes – le coût estimé est de 500 millions de dollars pour seulement six mois d’entraînement. Le marché de l’IA générative pesait près 44 milliards d’investissements en 2023, selon Fortune. A ce tarif-là, on peut comprendre que l’intérêt des entreprises actives dans ce secteur et de leurs actionnaires sont de convaincre sur l’inévitabilité de leur technologie, n’hésitant pas à en magnifier les potentialités et performances réelles, faisant fi de toutes limites, y compris hallucinations et biais.

Le « hype » est bien sûr entretenu par des stratégies marketing parfois très agressives, mais aussi par la foule de nouveaux experts de l’IA et futurologues en herbe qui peinent bien souvent à poser leurs lunettes roses sur leur clavier. Mais ceux-ci ne sont pas les seuls responsables, les journalistes aussi ont leur part de responsabilité, en personnalisant les technologies de l’IA à outrance (« L’IA sait », « L’IA pense », « L’IA ne veut pas », « L’IA n’aime pas »…) et en leur attribuant des capacités humaines qu’elles sont bien loin de rencontrer, de la créativité à l’intelligence générale en passant par l’empathie. Dans le journalisme, l’IA est parfois utilisée de manière trop large ou inexacte, pour désigner tout type de technologie avancée, qu’elle soit réellement basée sur de l’intelligence artificielle ou non. Cela contribue à la confusion et à la diffusion d’idées fausses sur ce qu’est l’IA, de la même manière que de nombreuses entreprises revendiquent l’usage de l’IA dans leurs produits, même si ce n’est pas véritablement le cas. S’ajoute la peur de ne pas être capable de prendre le train en marche, sans suffisamment questionner les véritables implications de ces technologies.

La bonne nouvelle est que malgré les discours magnifiant les technologies d’IA génératives dans leur capacité à remplacer des journalistes humains, ce n’est pas demain qu’une armée de logiciels prendra possession des contenus des médias d’information, ou en tout cas pas avec les caractéristiques de ce qu’est une information de qualité. Une preuve s’il en est, ce « robot » qui avait piqué le bon vieux job d’un journaliste et qui vient d’être viré. Dans le même temps, l’idée que l’IA est une bulle plutôt qu’une ruée vers l’or, fait de plus en plus son chemin dans certains discours publics, et la bulle serait d’ailleurs déjà, tout doucement, en train de se dégonfler.