Entre usages professionnels mesurés et transformations structurelles plus profondes, l’intégration des IA génératives dans le journalisme soulève des enjeux épistémiques et épistémologiques majeurs. Ce billet propose une lecture critique de ces mutations, du « fait émergent » à la médiation algorithmique, en interrogeant leurs implications démocratiques et éthiques.

Les technologies d’intelligence artificielle sont utilisées depuis pratiquement deux décennies dans le monde du journalisme, souvent sous des formes discrètes et largement naturalisées : moteurs de recherche, systèmes de recommandation, outils de transcription ou de traduction automatique. Ces dispositifs ont progressivement transformé les routines professionnelles sans remettre frontalement en cause les fondements épistémiques du journalisme. S’y ajoutaient des formes d’automatisation touchant aux mécanismes mêmes de production et de diffusion de l’information qui nourrissaient des débats éthiques encore peu répandus, questionnant les biais, la fiabilité et la transparence des processus, et leur impact sur la qualité de l’information.

Avec l’essor des intelligences artificielles génératives, l’idée largement répandue est qu’il ne s’agit plus seulement d’assister le travail journalistique ou de prendre en charge des tâches chronophages, mais d’intervenir directement dans la production de discours, de récits et de formes de factualité. Cette évolution engage une redéfinition des conditions mêmes du savoir, de la vérité et de l’autorité dans l’espace public. Pour autant, les études empiriques consacrées aux usages journalistiques nuancent l’idée d’une automatisation généralisée. Elles montrent que les journalistes mobilisent surtout les IA génératives comme des outils d’assistance intégrés à leurs routines : synthèse de documents, résumés de dépêches, aide à la formulation, reformulation ou adaptation de style.

Ces usages restent encadrés par une vigilance marquée à l’égard des risques pour la véracité, l’éthique professionnelle et l’autorité journalistique. L’accent est mis sur l’optimisation des flux de travail plutôt que sur la délégation de la production du contenu factuel, révélant une tension persistante entre gains d’efficacité et préservation du rôle du journaliste comme garant du sens et du vrai.

IA génératives, le grand malentendu

Un grand malentendu structure souvent le débat : les IA génératives sont fréquemment perçues comme des systèmes capables de restituer des connaissances, voire d’accéder au réel. Or, elles ne sont ni des bases de données ni des dispositifs de connaissance au sens classique. Ce sont des modèles statistiques de langage, entraînés à partir de corpus massifs afin de prédire la probabilité d’une séquence linguistique. Elles ne stockent pas des faits, ne se réfèrent pas à des événements, et ne disposent ni de mémoire historique ni de compréhension sémantique du monde.

Leur performance repose sur la capacité à produire des énoncés fluides, cohérents et contextuellement appropriés. Cette fluidité est précisément ce qui alimente une illusion d’intelligence, et plus encore, une illusion d’autorité épistémique. Les réponses produites sont plausibles, souvent convaincantes, mais intrinsèquement indépendantes de toute exigence de vérité ou de preuve.

Cette caractéristique fondamentale a des effets épistémiques immédiats. Les modèles sont entraînés sur des données de qualité hétérogène, largement issues d’Internet, où se mêlent savoirs experts, opinions, contenus biaisés, discours extrémistes et désinformation. Ils reproduisent et amplifient nécessairement ces asymétries : biais culturels et linguistiques, stéréotypes sociaux, visions du monde dominantes. Le phénomène des hallucinations, loin d’être marginal, est structurel.

A cela s’ajoute l’entraînement par renforcement à partir de retours humains, qui valorise la conformité, la satisfaction perçue et l’acceptabilité sociale plutôt que la justesse factuelle. La sycophantie algorithmique, que l’on peut définir comme la tendance des modèles à flatter, approuver ou valider les prémisses de l’utilisateur, illustre de manière éclairante cette logique. Elle pose un risque particulier dans des contextes journalistiques ou informationnels sensibles, où la contradiction, la mise à distance et la vérification sont des conditions essentielles de production du savoir.

Ces effets ne doivent cependant pas être pensés uniquement comme des dérives techniques. Ils s’inscrivent dans un cadre épistémologique plus large, qui concerne la manière dont le savoir est produit, perçu et légitimé. La rapidité et l’instantanéité constitutives des IA génératives participent à une reconfiguration radicale du rapport au temps. La réponse immédiate devient la norme, l’attente un signe d’inefficacité. Cette temporalité favorise la délégation de tâches cognitives aux machines au détriment de pratiques fondées sur le doute, la lenteur et la réflexivité.

L’agentivité humaine, entendue comme la capacité d’un sujet à se reconnaître comme auteur de ses actions et de ses décisions, s’en trouve fragilisée. Le risque n’est pas celui du remplacement du journaliste par une IA générative, mais bien celui de se retrouver progressivement dépossédé de certaines dimensions de son travail cognitif, y compris celle de la production de sens.

Une lecture épistémologique de l’école de Toronto permet d’éclairer cette transformation. Dans la lignée d’Innis et de McLuhan, il ne s’agit pas d’analyser uniquement les contenus produits par les technologies, mais de comprendre comment le médium lui‑même façonne les structures de perception et de pensée. Les IA génératives ne sont pas de simples outils : elles constituent un environnement cognitif. Leur interface suggère un échange dialogique, une compréhension, parfois même une intentionnalité. Le médium brouille le message : non pas en produisant nécessairement de faux contenus, mais en modifiant les conditions dans lesquelles le vrai est perçu comme tel.

C’est dans ce contexte que le concept de fait émergent est central. Dans le journalisme classique, le fait repose sur une exigence de vérité, qu’il soit conçu comme empirique, interprétatif ou institutionnel. Il est le résultat d’un travail de sélection, de vérification et de mise en récit assumé par un acteur identifiable. Avec les IA génératives, le fait est un produit calculé de manière probabiliste. Il émerge de l’interaction entre données d’entraînement, architecture du modèle, paramètres techniques et instructions de l’utilisateur. Il n’est pas une vérité préexistante révélée, mais un résultat probabiliste, adaptatif, variable et opaque. Sa cohérence linguistique peut masquer l’absence de fondement empirique. Le fait émergent ne peut être stable, dès lors qu’il est contingent et contextuel.

Une centralisation du contrôle du savoir

Le développement des IA génératives est indissociable de leurs logiques industrielles et politiques. Les grands modèles sont produits par un nombre restreint d’acteurs privés, principalement américains, inscrits dans des dynamiques économiques, idéologiques et géopolitiques spécifiques. Les cas de ChatGPT, Grok ou DeepSeek illustrent des orientations distinctes mais convergentes : biais idéologiques, contrôle politique, exploitation de discours non filtrés ou censure de sujets sensibles.

La centralisation des données et des capacités de production discursive accentue le contrôle du savoir et standardise les manières de raconter le monde. Cette homogénéisation est difficilement compatible avec l’idéal démocratique du journalisme, fondé sur le pluralisme, la diversité des voix et la responsabilité éditoriale.

Cette dimension est d’autant plus préoccupante que les intelligences artificielles génératives s’intègrent de plus en plus en amont de l’accès à l’information, notamment à travers des moteurs de recherche fondés sur des grands modèles de langage. Ces dispositifs ne se contentent plus de hiérarchiser des sources ou d’orienter la visibilité des contenus, mais synthétisent, reformulent et recomposent l’information en réponse aux requêtes des utilisateurs.

En brouillant la frontière entre recherche et production discursive, ils tendent à diluer la traçabilité des sources, à opacifier les chaînes de médiation et à affaiblir l’autonomie épistémique des usagers comme des professionnels. Le risque n’est alors pas seulement celui d’un biais de visibilité, mais celui d’une reconfiguration en amont des faits, des cadres interprétatifs et des critères de pertinence, selon des logiques algorithmiques largement soustraites au contrôle éditorial et démocratique.

Des discours médiatiques ambivalents

Les discours médiatiques sur l’IA participent eux‑mêmes à cette reconfiguration. La hype technologique, l’adoption du récit de l’inévitabilité et la reprise non critique des éléments de langage issus du big tech contribuent à naturaliser ces technologies et à en faire des horizons indiscutables de modernisation. L’« IA‑washing » masque les limites techniques des systèmes, leurs coûts environnementaux considérables, les enjeux de souveraineté numérique et les risques épistémiques qu’ils soulèvent. Cette naturalisation est d’autant plus efficace qu’elle s’appuie sur une rhétorique de la peur : la peur d’être dépassé, la peur de la perte d’emplois, la peur de l’obsolescence. La peur est ici un instrument d’incitation en faveur d’une adoption rapide plutôt qu’à un débat informé. La peur est mobilisée comme un instrument visant à accélérer l’adoption, plutôt qu’à nourrir un débat informé.

Parallèlement, des figures d’« experts » très visibles, souvent issues du monde entrepreneurial ou du conseil, occupent l’espace public au détriment de savoirs plus nuancés, produits par les sciences informatiques, les sciences sociales ou les études critiques des technologies. Leur discours tend à simplifier à l’extrême des notions complexes, à promouvoir l’idée d’une « IA intelligente » ou quasi autonome, et à occulter les contraintes structurelles des modèles. Cette sélection médiatique de l’expertise favorise une vision performative et enchantée de l’IA, tout en affaiblissant la capacité critique des journalistes et des publics.

Cela étant, les discours deviennent plus prudents, voire critiques, lorsqu’ils concernent directement les rédactions : menaces sur l’emploi, brouillage des frontières entre information et fiction, prolifération de contenus trompeurs. Mais cette vigilance coexiste avec une adoption pragmatique et parfois enthousiaste des outils, souvent présentés comme des assistants neutres améliorant la productivité. Il en résulte une tension durable entre, d’une part, un usage mesuré et encadré des IA génératives dans les routines professionnelles, et, d’autre part, des récits médiatiques qui contribuent à amplifier leur pouvoir symbolique et leur autorité perçue.

Ces discours participent également à renforcer des imaginaires puissants : celui de la machine qui « comprend », qui « raisonne » et qui dépasse l’humain, ou à l’inverse celui d’un outil miraculeux de progrès et d’efficacité. En alimentant l’anthropomorphisme et en valorisant des interfaces conversationnelles fluides, les médias contribuent à brouiller la distinction entre calcul statistique et intelligence humaine. Le risque est alors moins celui d’une adhésion naïve à des technologies surévaluées que celui d’une transformation silencieuse des cadres cognitifs à partir desquels le savoir, l’information et la vérité sont pensés.

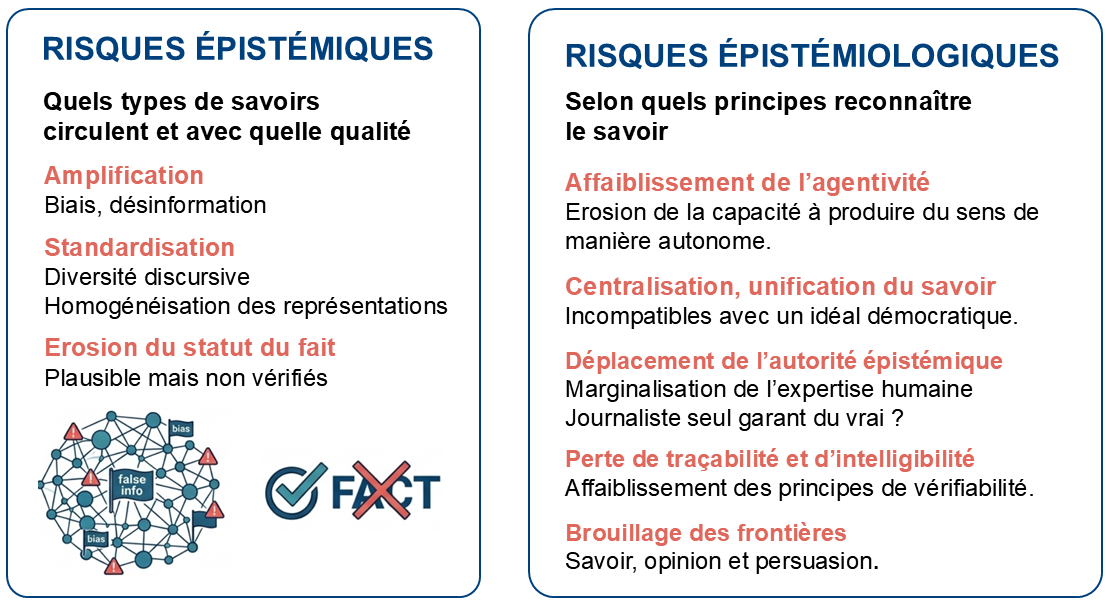

La question centrale n’est donc pas seulement celle des usages et des risques épistémiques, qui concernent la qualité et la diversité de l’information, et des risques épistémologiques, relatifs aux normes du vrai, de l’autorité et de la responsabilité. Elle est aussi celle de la capacité du journalisme à préserver une agentivité critique, à maintenir la traçabilité du savoir et à résister à la naturalisation du calcul probabiliste comme substitut du réel.

Cette exigence éthique est d’ailleurs largement reconnue dans les textes de recommandations et cadres normatifs consacrés aux intelligences artificielles génératives, qu’ils soient institutionnels, professionnels ou déontologiques. Ces documents n’adoptent généralement pas une conception monolithique de l’éthique, mais articulent explicitement plusieurs registres complémentaires : une éthique de la vertu, centrée sur l’intégrité, la responsabilité et le jugement des acteurs humains ; une éthique conséquentialiste, attentive aux impacts sociaux, démocratiques et informationnels des usages ; et une éthique du devoir, fondée sur des principes et des règles visant à garantir la transparence, l’exactitude, la traçabilité et la responsabilité. Toutefois, si cette pluralité éthique est désormais bien intégrée sur le plan normatif, elle se heurte dans les pratiques à la complexité des environnements techniques et rédactionnels, où les décisions sont de plus en plus distribuées entre humains et systèmes.